在业界对新一代旗舰模型DeepSeek V4的翘首期盼中配资公司分析工具,DeepSeek团队却悄然放出了一篇新的学术论文。

这篇论文由DeepSeek联合北大、清华共同撰写,将研究方向投向了决定大模型实际应用落地的关键一环——推理速度,为日益复杂的AI智能体,提供一套高效的底层系统解决方案。

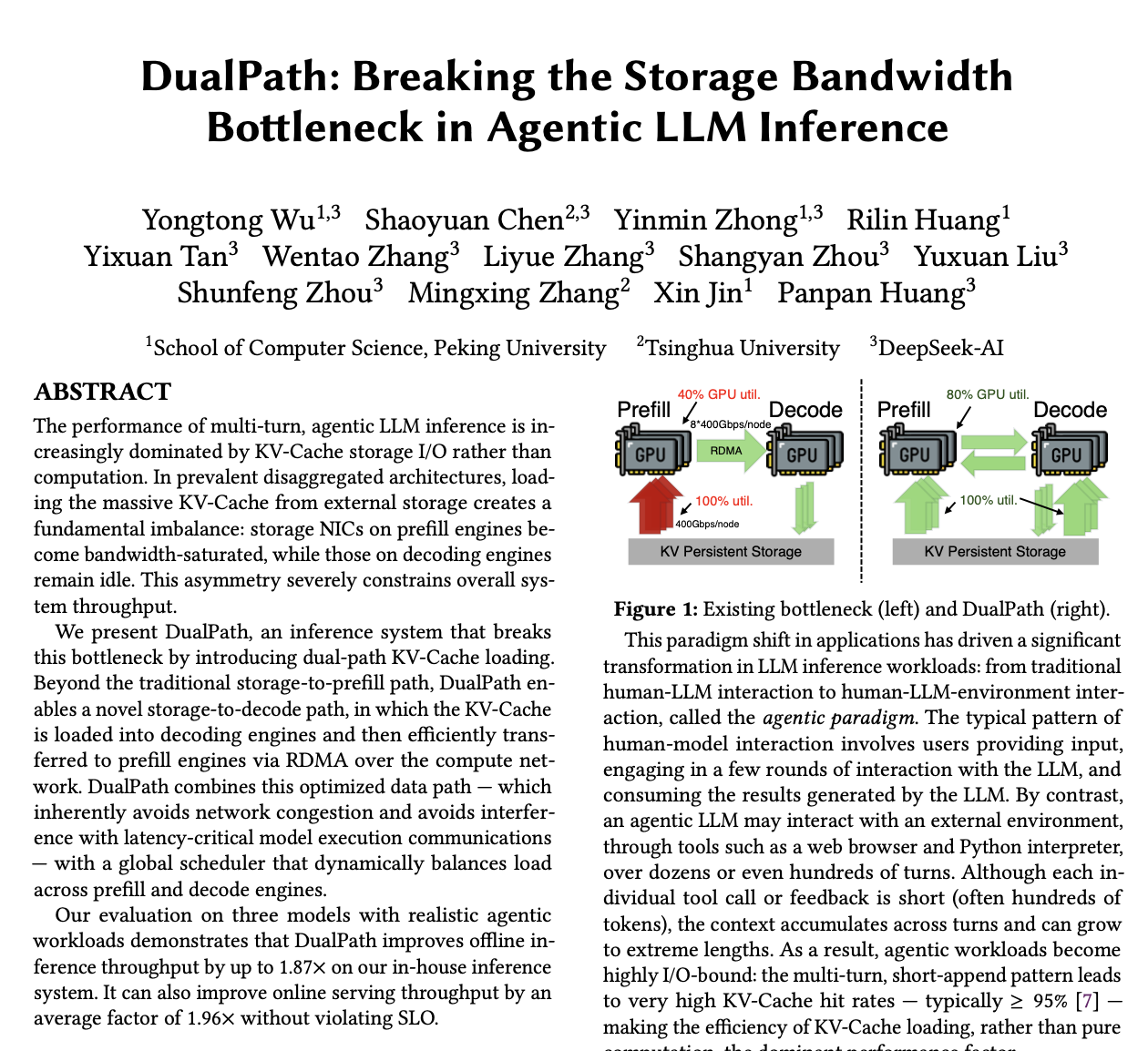

元股证券:yy6699.vip具体来说,新论文介绍了一个名为DualPath的创新推理系统,专门针对智能体工作负载下的大模型(LLM)推理性能进行优化。通过引入“双路径读取KV-Cache(类似记忆缓存)”机制,重新分配存储网络负载,将离线推理吞吐量最高提升 1.87 倍,在线服务的每秒智能体运行数平均提升 1.96 倍。

论文在引言部分提到,大模型正从单轮对话机器人和独立推理模型,快速演进为智能体系统 ——能够自主规划、调用工具,并通过多轮交互解决实际任务。这种应用范式的转变,推动大模型推理工作负载发生重大变革:从传统的人类-大模型交互,转向人类-大模型-环境交互,交互轮次可达数十甚至数百轮。

上下文会跨轮次累积,最终长度可能达到极值。此时模型不需要大量计算,反而需要频繁从硬盘读取历史上下文的 KV-Cache;现有系统中,只有负责预处理的引擎会读取KV-Cache,它的网卡带宽被占满,而负责生成内容的解码引擎,网卡带宽基本闲置,导致整个系统速度被卡脖子。

因此,论文提出的DualPath,针对智能体工作负载、重新设计现代推理架构中 KV-Cache加载逻辑,解决大模型做智能体任务时,速度被 “数据读取”拖慢的核心问题,重要的是把闲置的带宽资源利用起来,相当于给数据读取 “多开了一条高速路”,实现速度的大幅提升。

这一论文成果延续了DeepSeek一贯的风格,在工程化层面将性能优化推向极致。有从业者认为,DeepSeek做这类优化属于缺显卡的无奈之举,属于“脏活儿累活儿”,大家更期待团队在模型上做创新。

但也有人认为,即便有足够显卡,永元配资官网这类优化在降低成本、降低token费用方面也很有价值,因为只有足够便宜,AI才能走向大规模使用。

相比这篇“务实”的论文,外界显然更关注DeepSeek新一代旗舰模型的真面目。关于DeepSeek V4的发布时间,市场传闻已几经更迭。从最初传闻的2月春节前后,到外媒最新报道的“最快下周”,再到业内人士预测的3月前后,传闻链条愈发扑朔迷离。

就在近日,外网有网友爆料称,DeepSeek 正在测试 V4 Lite 模型,代号为“Sealion-lite”,上下文窗口为 100万tokens,并原生支持多模态推理。也有消息提及,DeepSeek已在近期将重大更新版本V4向华为等国内厂商提供提前访问权,以支持其优化处理器软件,确保模型在硬件上高效运行。然而,英伟达等厂商尚未获得类似权限。

面对传闻,DeepSeek依旧保持其一贯的沉默,目前并未进行任何回应。但市场已进入“严阵以待”状态,部分投资机构担忧,新一代模型的发布会如同去年的版本发布时那样,引发市场的剧烈震荡。

举报 第一财经广告合作,请点击这里此内容为第一财经原创,著作权归第一财经所有。未经第一财经书面授权,不得以任何方式加以使用,包括转载、摘编、复制或建立镜像。第一财经保留追究侵权者法律责任的权利。如需获得授权请联系第一财经版权部:banquan@yicai.com 文章作者

刘晓洁

相关阅读 科学家的超级合伙人来了,戴上“金箍”的智能体更神通

科学家的超级合伙人来了,戴上“金箍”的智能体更神通科学智能发展面临的核心问题也在变化。

27 1小时前 国家卫健委:加强外文期刊撤稿论文主动监测

国家卫健委:加强外文期刊撤稿论文主动监测力争通过3年,遏制论文造假等突出科研失信问题。

156 昨天 16:52 中科院拟停止支付开放获取期刊高额文章处理费?多名研究员回应

中科院拟停止支付开放获取期刊高额文章处理费?多名研究员回应经费管理的调整一方面可能旨在控制成本,另一方面也是科研话语权的争夺,旨在扶持中国本土期刊。

510 02-26 19:30 两个春节,一年时间:战火烧红整条AI产业链 | 海斌访谈

两个春节,一年时间:战火烧红整条AI产业链 | 海斌访谈国民级流量入口的竞争,一个春节是分不出胜负的

10 456 02-18 16:52 上海买个菜竟能偶遇黄仁勋?网友直呼“不得了”!

上海买个菜竟能偶遇黄仁勋?网友直呼“不得了”!全球第一大市值公司老板沉浸式体验上海菜场,有网友直呼“乖乖配资公司分析工具,不得了了!”,还有人惊喜地表示:“在上海买个菜都能偶遇全球显卡首富。“

982 01-24 21:39 一财最热 点击关闭全国港股配资测评|打新融资实力对比|永元证券提示:本文来自互联网,不代表本网站观点。